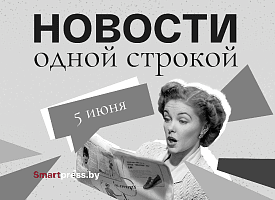

Апрель 2026-го сильно упростил несколько дорогих задач. Видео теперь можно собрать за вечер, музыку - за час, найти ошибки в 100 раз проверенном коде - в разы быстрее. Вместе с этим выросли риски: те же инструменты легко уходят “в серую зону” и начинают работать во вред. Собрали четыре ключевых релиза месяца – и разложили, где здесь реальная польза, а где потенциальная проблема.

Claude Mythos: модель, которую побоялись представить публично

7 апреля Anthropic (та самая компания, которая делает Claude) представила Claude Mythos Preview - модель, специально заточенную под поиск уязвимостей в программном обеспечении. Это не массовый продукт: доступ открыли всего нескольким десяткам компаний - среди них Amazon, Apple, Microsoft, Cisco, CrowdStrike, Palo Alto Networks и Linux Foundation. Инициатива называется Project Glasswing, и смысл ее прост: дать крупным игрокам инструмент, который может найти баги в их же софте быстрее, чем это сделают злоумышленники.

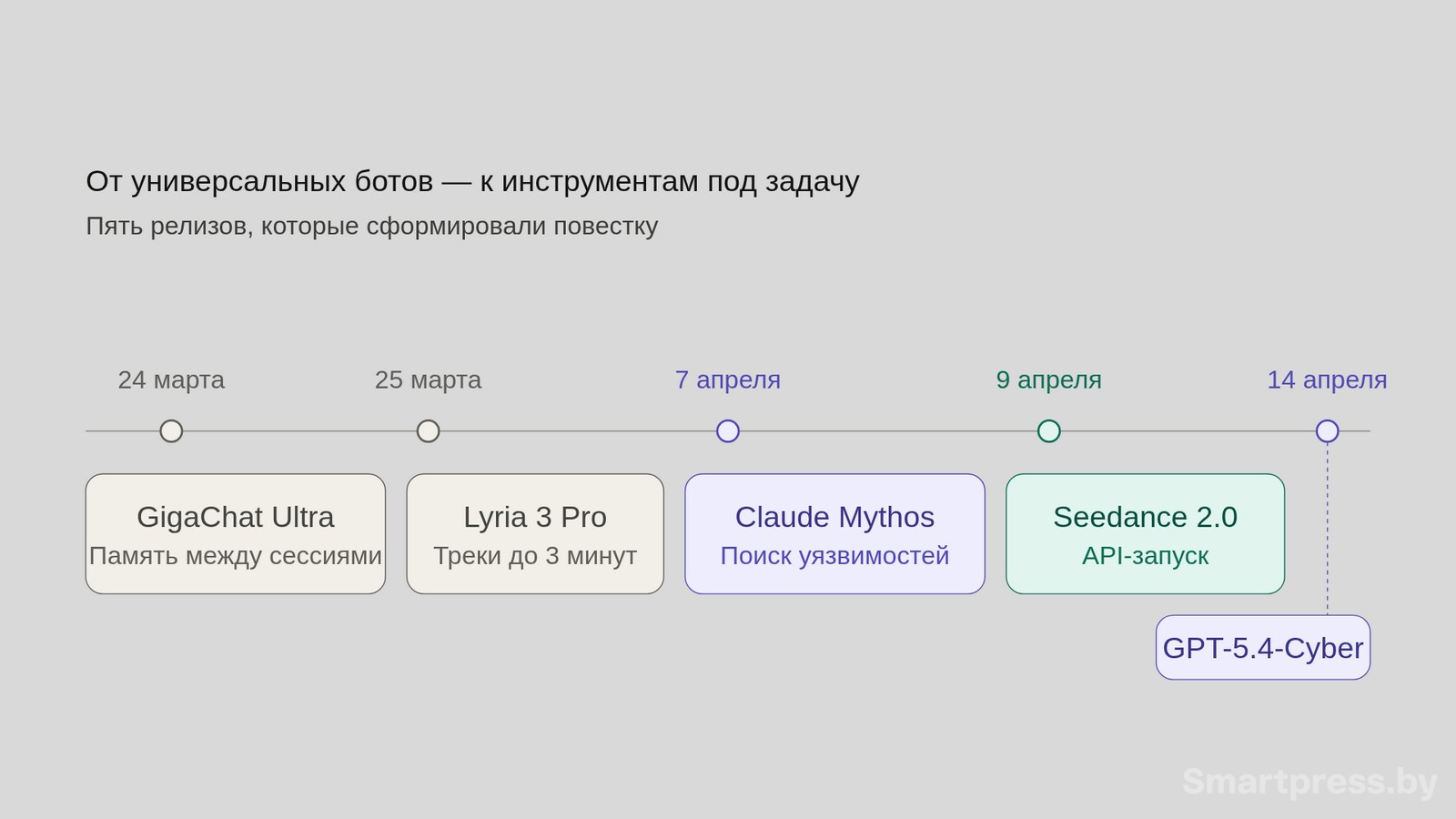

Mythos выполняет многоступенчатые атаки и самостоятельно находит уязвимости - задачи, на которые у живого специалиста уходят дни. Сама Anthropic называет главным трофеем 17-летний баг в FreeBSD (CVE-2026-4747), который Mythos нашел без помощи человека.

А СМИ сообщили, что к Mythos уже получила доступ группа посторонних пользователей - через портал подрядчика Anthropic. Компания подтвердила: идет расследование. Источники Bloomberg говорят, что это небольшое сообщество в закрытом Discord-канале, и они “просто хотели попробовать”. Но сам факт красноречивый: модель, которую сознательно не выпускают в мир, утекла в день анонса.

Что это значит на практике. Граница между “ИИ для защиты” и “ИИ для атаки” во многом условная. Тот же самый код, который находит дыру, чтобы ее закрыть, находит ее и для того, чтобы через нее войти. Вопрос только в мотивации.

GPT-5.4-Cyber: ответ OpenAI - и другой подход к той же проблеме

Через неделю после Mythos, 14 апреля, OpenAI выкатила GPT-5.4-Cyber - специальную версию своей флагманской модели, дообученную под задачи кибербезопасности. Логика похожая: дать защитникам инструмент, сопоставимый с тем, что уже есть у атакующих.

Интересно, чем подход OpenAI отличается. Обычный GPT-5.4 часто отказывается помогать с запросами, которые касаются уязвимостей - даже когда они нужны для легальной работы. GPT-5.4-Cyber этой осторожности лишен: модель называется “cyber-permissive” (более разрешительной в кибер-сценариях). Но доступ к ней - только через программу Trusted Access for Cyber, и только на верхнем уровне, куда пускают после верификации личности и проверки.

То есть OpenAI делает ставку не на то, чтобы ограничить возможности модели, а на то, чтобы проверять, кому эти возможности достаются.

Для кого. Пока для информационной безопасности корпоративных команд. Рядовому пользователю ни Mythos, ни GPT-5.4-Cyber не достанется.

Seedance 2.0: китайский ответ Sora и Veo - и он впечатляет

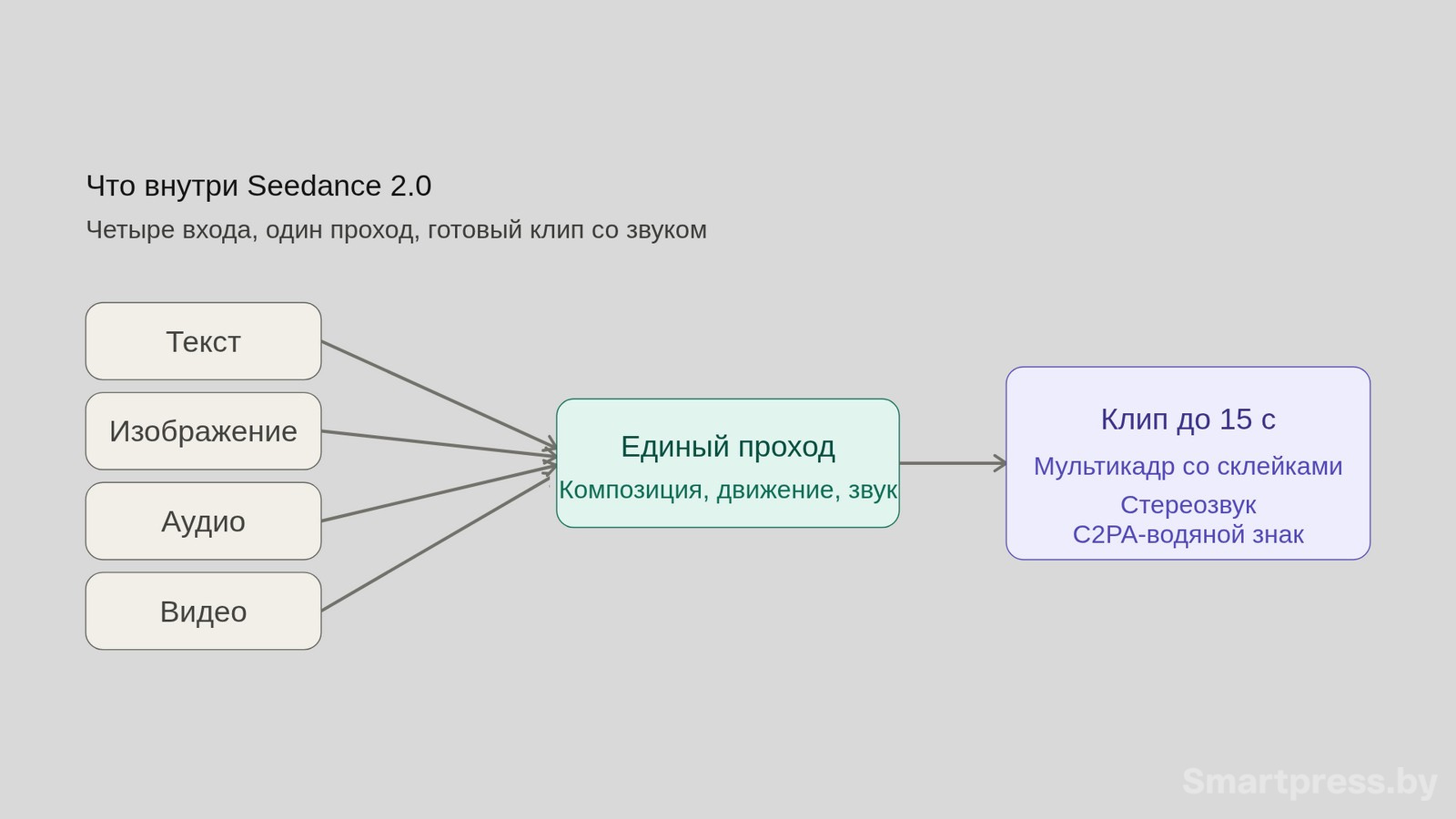

ByteDance (компания, которой принадлежит TikTok) выпустила Seedance 2.0 еще в феврале, но именно в апреле модель стала массово доступной: 9 апреля запустился API на платформе fal, а еще раньше ее встроили в CapCut и Dreamina - приложения, которыми пользуются миллионы.

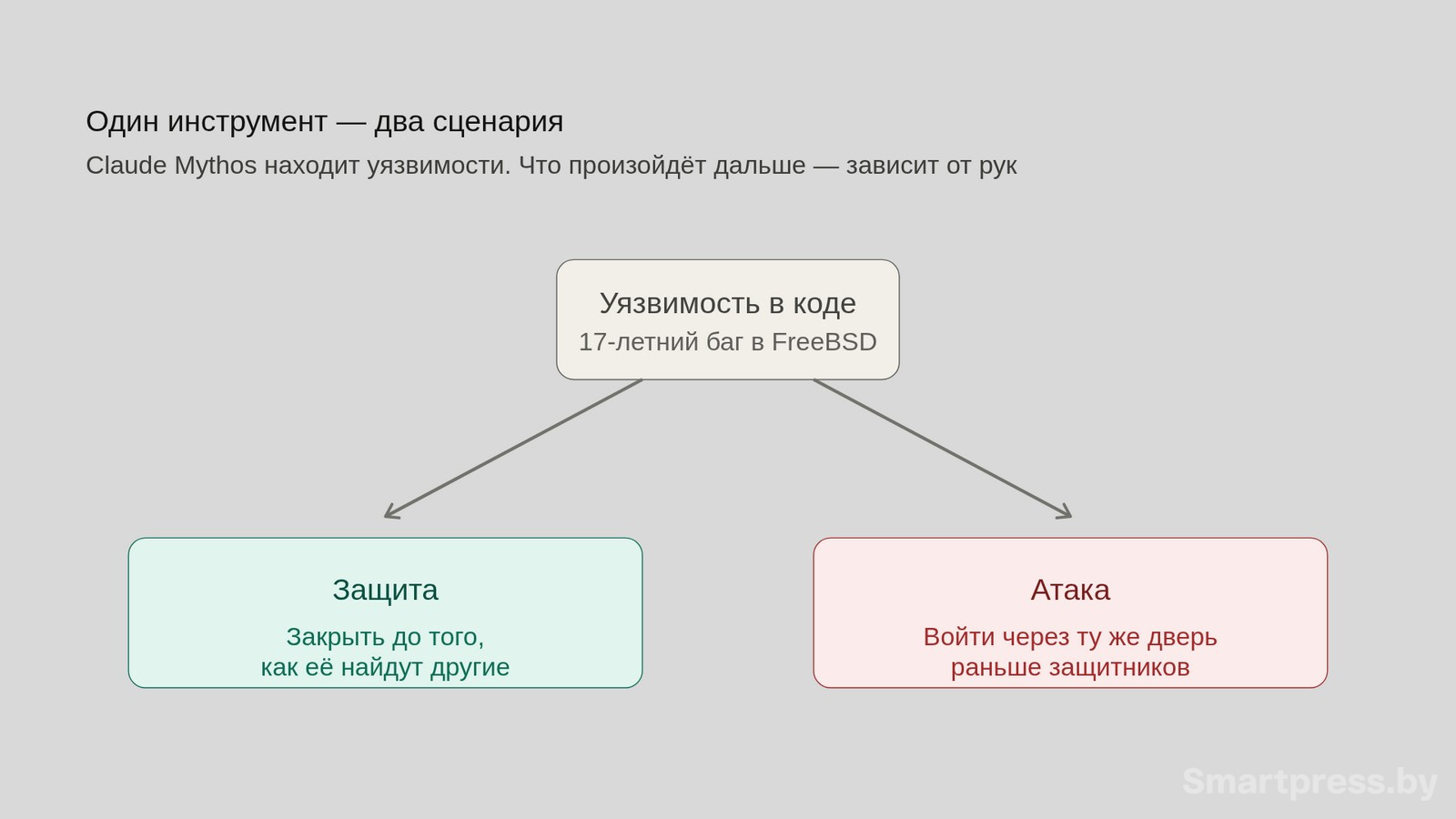

Что она умеет. До 15 секунд видео со встроенным стереозвуком, в одном проходе, по текстовому описанию, картинке, аудио или короткому видео. Несколько сцен внутри одного ролика с естественными склейками. Важно: руки не деформируются, предметы ведут себя как положено, свет работает правдоподобно. На независимом рейтинге Artificial Analysis Seedance 2.0 держится в топе среди моделей image-to-video с синхронизированным звуком.

Для медийной и креативной работы это большая новость. Еще год назад сгенерированное видео узнавалось на раз-два по нарушенной биомеханике движений. Сейчас Seedance 2.0 выдает клипы, которые в соцсетях сходят за настоящую съемку. Википедия уже фиксирует, что в Китае после релиза начали массово появляться вирусные ролики с настоящими актерами и сценами из известных фильмов - с предсказуемыми вопросами к авторскому праву.

ByteDance это понимает: в Seedance 2.0 встроили IP-защиту и C2PA-водяные знаки - невидимую маркировку, которая позволяет отличить сгенерированное видео от снятого. Работает ли это в реальности, когда ролик прошел через три пересжатия, отдельный вопрос.

Что это меняет для работы с контентом. Производство видео дешевеет на порядок. Черновик рекламного ролика, визуальная раскадровка, драфт для презентации, короткий клип для соцсетей - всё это теперь делается за минуты вместо дней. Но вместе с удешевлением приходит обесценивание: если видео больше не требует съемочной группы, то и доверия к нему как к свидетельству становится меньше. Это не катастрофа, это просто новая норма, к которой редакциям придется привыкать - и учиться верифицировать визуальные материалы по-новому.

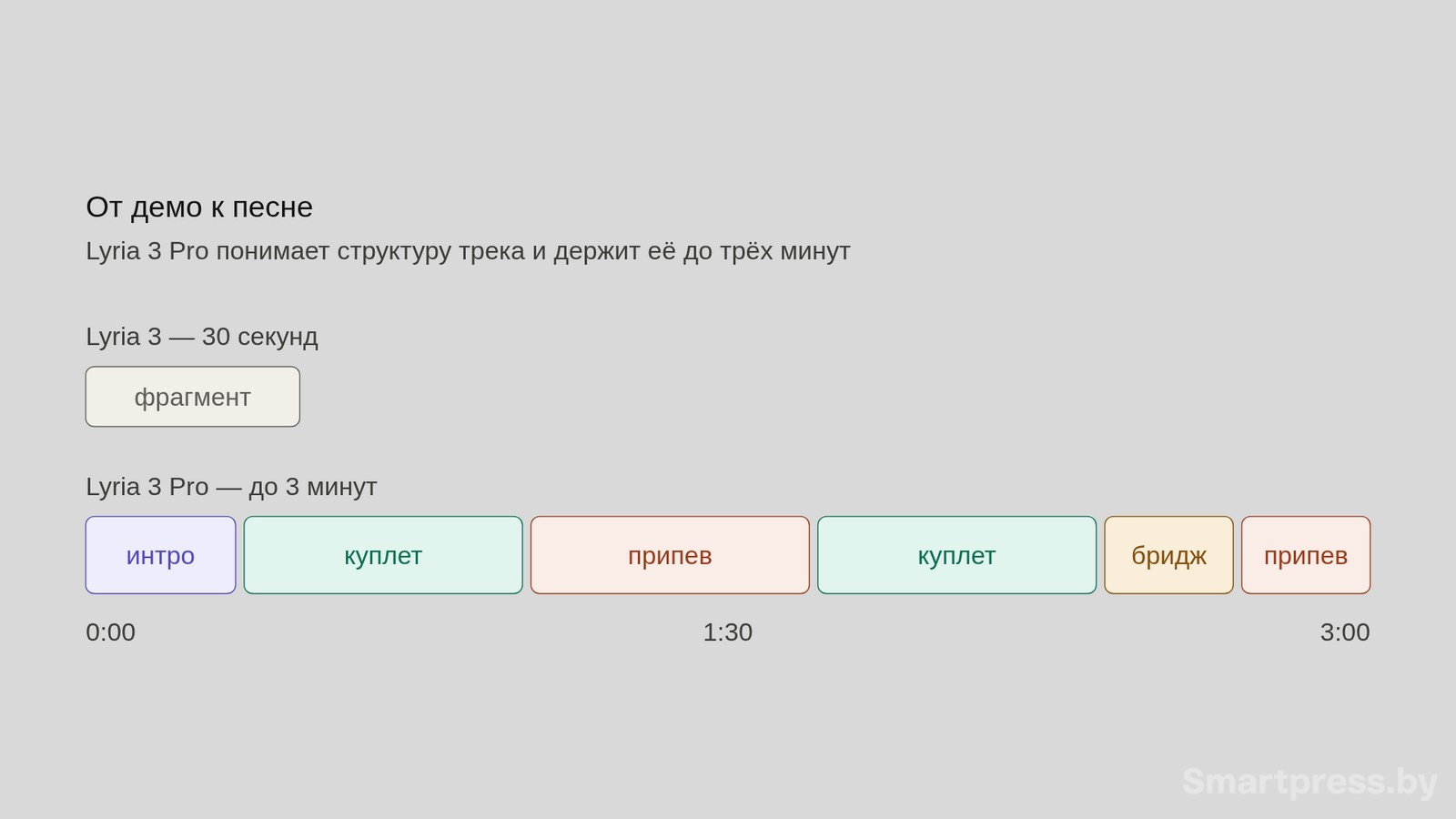

Lyria 3 Pro: музыка, которая перестала быть демо

25 марта Google выпустил Lyria 3 Pro - новую версию своей модели для генерации музыки. Разница с предшественницей заметная: Lyria 3 делала 30-секундные фрагменты, Lyria 3 Pro - полноценные треки до трех минут. В промпте можно отдельно задать интро, куплет, припев, бридж - модель понимает структуру песни и держит ее.

Доступ есть через приложение Gemini (для платных подписчиков), через Vertex AI и Gemini API (для бизнеса и разработчиков), через Google Vids (видеоредактор) и через ProducerAI. Google уточняет: модель не копирует конкретных артистов, но если в промпте указать имя, возьмет у него “общее вдохновение”. Все треки маркируются невидимым знаком SynthID.

Где это полезно прямо сейчас. Музыкальная подложка для видеоматериала без претензий по авторским правам, быстрые черновики для подкаста, звуковой фон для презентаций. Для креативных команд - это отличный инструмент.

Что есть для русскоязычного пользователя

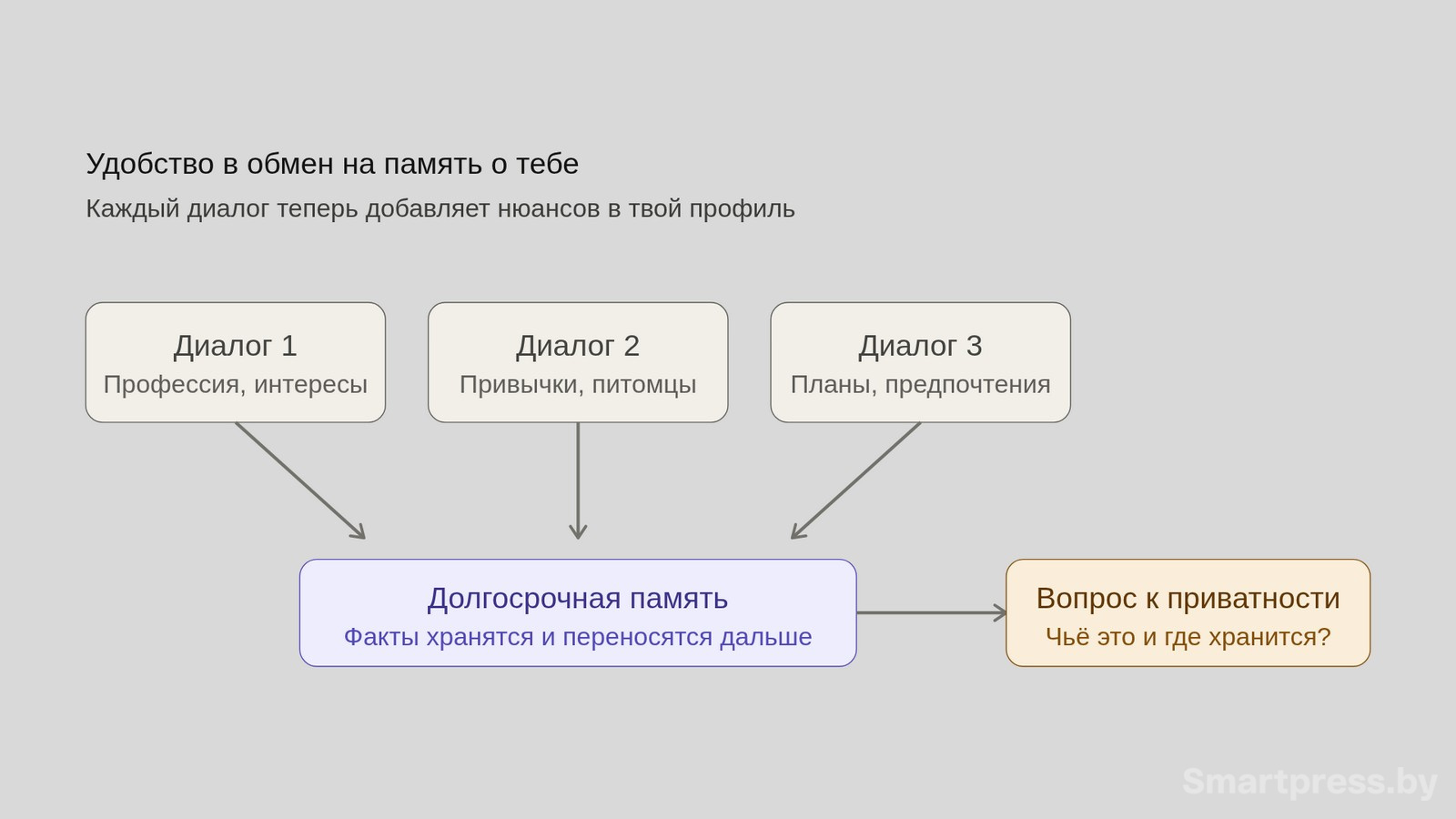

24 марта Сбер обновил GigaChat и перевел его на флагманскую модель GigaChat Ultra. Ключевое нововведение - долгосрочная память: ассистент запоминает ваши интересы, профессию, предпочтения и переносит их из одного разговора в другой.

Функция эта уже есть у ChatGPT и Claude, но ее появление у GigaChat важно по двум причинам. Первая - практическая: для пользователей из стран, где доступ к западным сервисам затруднен, это заметное улучшение качества. Вторая - принципиальная: чем больше моделей помнят о нас детали, тем острее встает вопрос, кому именно эта память принадлежит, где хранится и что с ней может случиться. “Удобство за счет приватности” - это личная сделка для каждого из нас.

Три вывода

Первый. ИИ в 2026-м - это не одна нейросеть на все случаи жизни, а набор инструментов под конкретные задачи. Писать - в одной модели, снимать - в другой, защищать инфраструктуру - в третьей. Универсальных ответов больше не будет, и это скорее хорошо: специализация обычно означает качество. Но обходится дороже, даже в базовых версиях.

Второй. Граница между “полезно” и “опасно” в апрельских релизах окончательно размылась. Mythos, который слили, Seedance с фейковыми роликами реальных актеров - новая реальность.

Третий. Для рядового пользователя самые осязаемые изменения - в производстве контента. Видео и музыка впервые стали по-настоящему доступны без бюджета и команды. Это значит, что в ближайшие месяцы мы увидим новых интересных авторов, и огромное количество визуального шума. Различать одно от другого - теперь отдельный навык, который стоит тренировать.

Автор: Юлия Кочубей

*Использование и цитирование данной статьи допускается в объеме, не превышающем 20% при наличии гиперссылки. Более 20% – только с разрешения редакции.