Главной причиной исков стало обучение моделей на чужом контенте без явного разрешения. А также ответы моделей, слишком близко копирующие защищенные авторским правом работы.

Массовых судебных прецедентов против рядовых пользователей ИИ почти нет. Но есть реальные претензии.

Где бренды попали с ИИ

В 2024-2025 годах основные иски поданы к компаниям, которые разрабатывают и обучают модели: Getty Images против Stability AI, иски художников к Midjourney и Stability, претензии издателей и медиа к OpenAI и Anthropic. Предмет споров – обучение моделей на защищенных данных без лицензий и воспроизведение охраняемого контента.

Однако в последнее время правообладатели уже адресуют претензии не платформам, а конечным пользователям: музыкантам, дизайнерам, брендам, медиа, которые публикуют или монетизируют AI-контент. Юридическая логика сейчас такая: личное использование почти не трогают, публичное и коммерческое – в зоне внимания. Как только появятся устойчивые кейсы с ущербом или деньгами, судебные прецеденты против пользователей станут вероятными. Так что, если вы используете результат ИИ публично или в бизнесе, отвечать, скорее всего, будете вы.

В зоне риска стили известных авторов. Sony Music, Universal Music Group, Warner Music в 2024–2025 массово рассылали официальные требования удалить AI-треки, где:

- использовались “голоса, похожие на” известных артистов,

- либо имитировали стиль конкретного исполнителя.

Адресатами были не AI-компании, а конкретные авторы треков, TikTok-креаторы, небольшие студии.

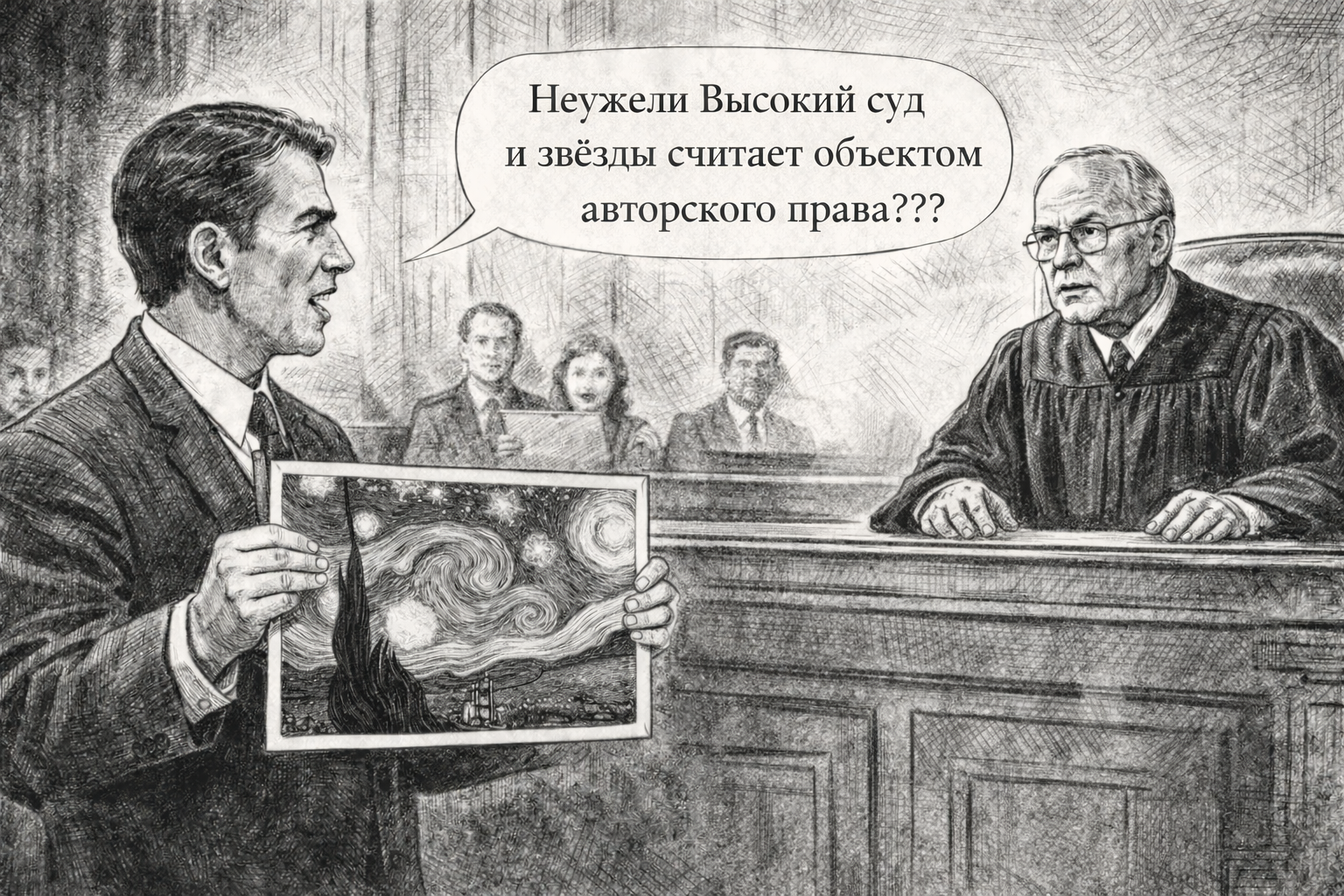

GPTs “Иллюстратор SP” в стиле газетной иллюстрации судебных очерков NYT – не является объектом авторского права

GPTs “Иллюстратор SP” в стиле газетной иллюстрации судебных очерков NYT – не является объектом авторского права

Авторские права: кто владеет текстами и визуалом ИИ

Вы сгенерировали образ или мелодию, они завирусились, и другие бренды начали использовать их в рекламе. Классический кейс – образ “ИИ-Снегурочки” от Саши Камович: визуал создан с помощью нейросети, но авторство идеи и промта не очевидно, а юридически защищать такой образ почти невозможно.

Что запрещено в Европе и США. Что с Беларусью

В ЕС запрещено использование ИИ для скрытого биометрического распознавания, социального скоринга и манипулятивных интерфейсов; в США – жёсткие ограничения через судебную практику и регуляторов. В Беларуси прямого профильного закона пока нет, ответственность ложится на общие нормы о персональных данных, коммерческой тайне и авторском праве.

Нельзя генерировать контент, который выглядит как официальный документ, медицинское заключение или юридическая консультация от имени компании. Пример: “договор с клиентом”, сгенерированный ИИ без юриста.

Как правильно оформлять данные без утечки

Нельзя загружать в ИИ “сырые” клиентские базы, договоры, медицинские или HR-данные. Пример: перед анализом обращений клиентов текст проходит очистку от имён, телефонов, e-mail и ID – только после этого попадает в модель.

В компании должен быть прописан минимальный чек-лист. Например: “Запрещено использовать публичные ИИ-сервисы для обработки внутренних документов, персональных данных и клиентской информации без анонимизации”.

Подробный чек-лист по рискам и безопасности использования ИИ вы получите на Конференции ИИ-2026. “Рабочие правила, практика, риски”. Посмотреть программу конференции или купить билеты можно ЗДЕСЬ.